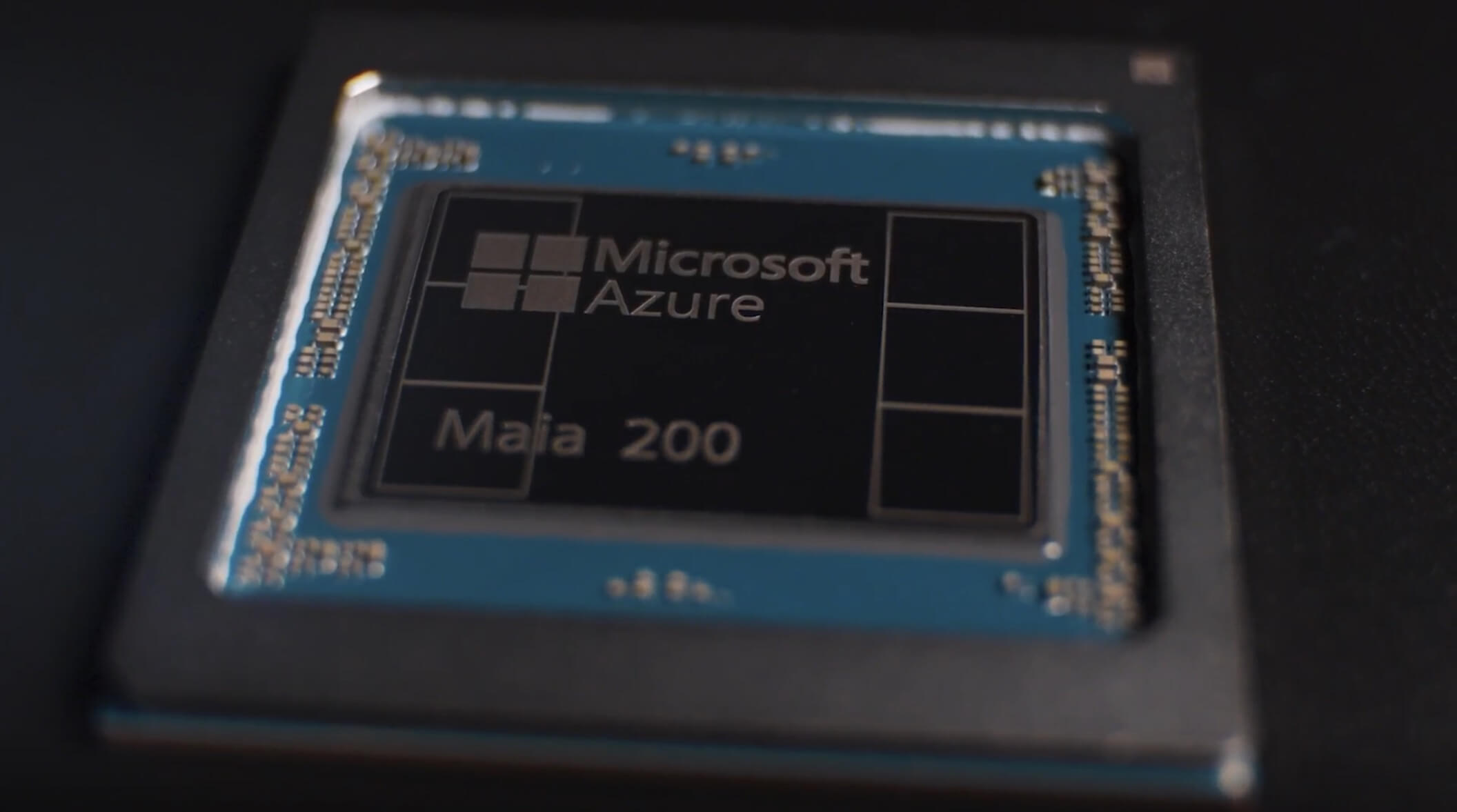

Microsoft анонсировала свой новый и самый мощный ускоритель искусственного интеллекта. Чип под названием Microsoft Azure Maia 200 стал вторым поколением семейства графических процессоров Maia.

Azure Maia 200 разработан специально для задач ИИ-инференса на стороне сервера и, по заявлению Microsoft, обеспечивает более высокую пропускную способность и производительность по сравнению с проприетарными решениями конкурентов, включая Amazon и Google.

Особенности

Microsoft называет Maia 200 своей самой эффективной системой для выполнения вычислительных задач на сегодняшний день. По данным компании, новый ускоритель демонстрирует прирост производительности на 30% в пересчёте на доллар по сравнению с Maia 100. Это особенно примечательно с учётом того, что показатель TDP у Maia 200 примерно на 50% выше, чем у предыдущего поколения.

Maia 200 производится по 3-нм техпроцессу TSMC и содержит около 140 миллиардов транзисторов. Согласно информации Microsoft, чип способен обеспечивать до 10 петафлопс производительности в вычислениях FP4, что примерно в три раза превышает показатели решения Amazon Trainium3.

Ускоритель оснащён 216 ГБ встроенной памяти HBM3e с суммарной пропускной способностью до 7 ТБ/с. Дополнительно предусмотрено 272 МБ интегрированной SRAM. Архитектура Maia 200 изначально оптимизирована для работы с форматами FP4 и FP8, что делает его особенно эффективным для современных ИИ-нагрузок.

Сроки выхода

Microsoft сообщила, что Maia 200 уже используется в центральном дата-центре Azure в США. В ближайшее время компания планирует развернуть новые ускорители и в других регионах.