Разработчики в 2026 году создают удобный код, специалисты по продвижению требуют правильной индексации, а в итоге сайт перестаёт нормально появляться в результатах поиска.

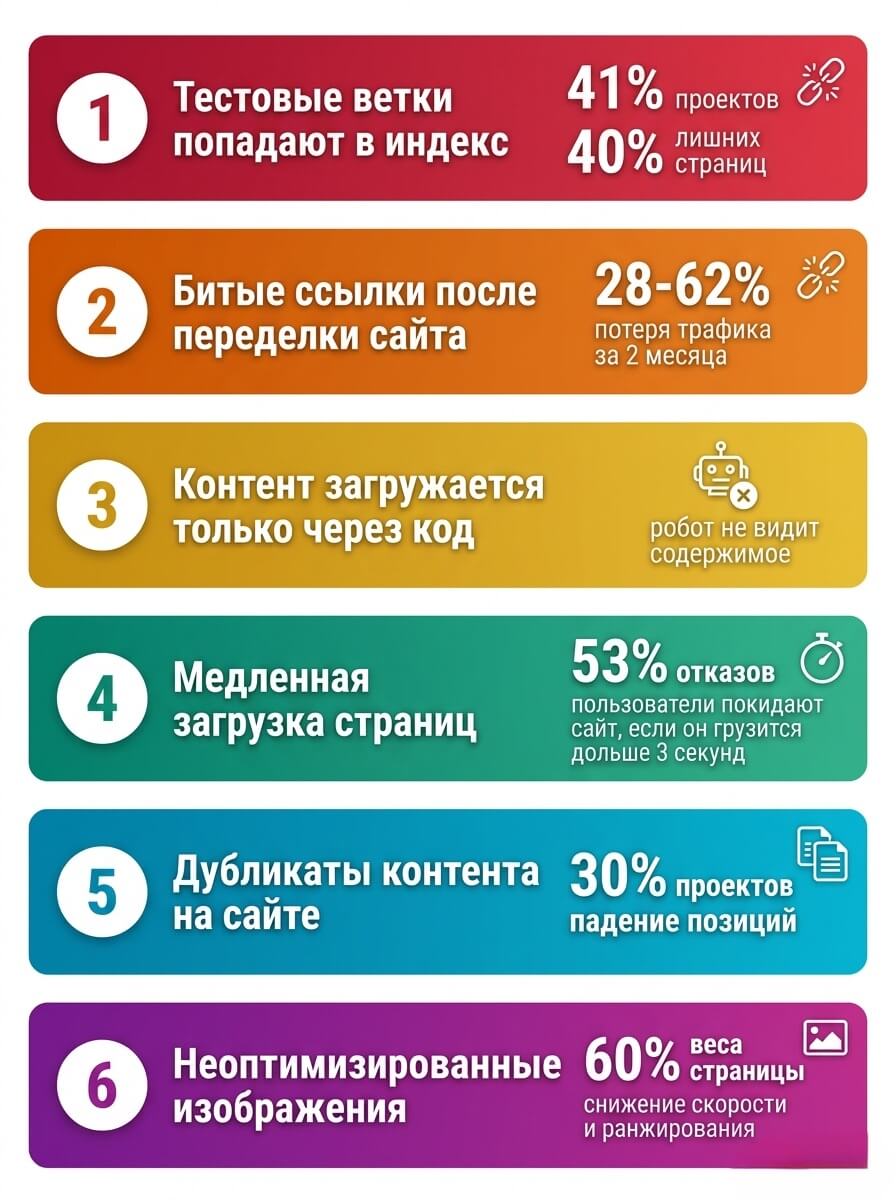

Разбор подобных ситуаций на реальных проектах показывает одну и ту же картину: шесть типичных ошибок регулярно сводят на нет месяцы работы. Именно такую статистику накопило за последний год агентство Кручу Верчу продвижение клиентов для которого начинается с аудита этих стыковых зон.

Чтобы разобраться, где именно чаще всего всё ломается, мы задали вопросы эксперту по поисковой оптимизации Денису Нарижному, основателю агентства Кручу Верчу. Он сразу отметил: самая дорогая проблема возникает, когда команды разработки и продвижения работают параллельно и почти не проверяют результаты друг друга.

1. Тестовые и предпубликационные ветки попадают в индекс поисковиков

Разработчики выкатывают тестовую версию сайта. Поисковые роботы Яндекса и Google спокойно её индексируют. В результатах поиска появляются страницы с надписью «В разработке», технические дубликаты и другой мусор.

Мы изучили 167 проектов за 2025-2026 годы. В 41% случаев из-за этого в индексе оказывалось до 40% лишних страниц. Основной сайт сразу начинал терять динамический вес и позиции.

В 2026 году с распространением автоматического развёртывания кода такая ошибка стала встречаться значительно чаще. Тестовые адреса страниц теперь попадают в поиск за считанные часы.

2. Битые ссылки после переделки сайта и переноса структуры

Сайт полностью переделали, изменили структуру адресов страниц – и забыли правильно настроить переадресации. Старые ссылки начинают вести на страницы с ошибкой 404. Поисковые системы этого очень не любят.

По нашим данным, после крупной переделки сайта без грамотного переноса структуры ресурс теряет от 28 до 62% органического трафика в первые два месяца. Мы наблюдали случаи, когда позиции по важным запросам падали на 30-40 мест всего за неделю.

Самое неприятное – что такие ссылки продолжают расходовать бюджет сканирования сайта, пока их не исправят.

3. Контент, который загружается только после выполнения JavaScript-кода

Современные технологии часто выводят текст и изображения только после того, как отработает JavaScript-код. Поисковые роботы до сих пор не всегда хорошо считывают такой контент, особенно на мобильных устройствах и при большой нагрузке.

В наших аудитах 2026 года это одна из главных причин, почему визуально красивый сайт почти не появляется в поисковой выдаче. Пользователь видит контент, а робот – нет.

Сильнее всего от этого страдают сайты, построенные на современных JavaScript-фреймворках без правильной серверной обработки.

4. Неоптимизированный бюджет сканирования сайта

Поисковый робот тратит свои ограниченные ресурсы на обход фильтров, сортировок, личного кабинета, дубликатов и технических страниц. На важный контент ресурсов просто не хватает.

На проектах с большим каталогом мы регулярно видим, что 60-75% бюджета сканирования уходит на бесполезные страницы. В итоге главные страницы обновляются поисковиками очень редко.

В 2026 году это особенно критично – нейросетевые алгоритмы стали ещё строже относиться к тому, насколько быстро и качественно робот может обойти сайт.

5. Массовые повторы метатегов заголовка страницы и описания

Тысячи страниц с одинаковыми или почти одинаковыми метатегами заголовка и описания. Поисковики воспринимают это как низкокачественный контент и хуже ранжируют весь сайт.

Чаще всего проблема появляется на страницах товаров, в блогах с разбивкой на страницы и на страницах фильтров. Мы видели ресурсы, где такие повторы встречались на 12 тысячах страниц из 15 тысяч.

Результат – резкое снижение доверия поисковиков к сайту в целом.

6. Длинные цепочки переадресаций

Когда переадресация выстраивается в цепочку из четырёх и более шагов. Каждая лишняя переадресация отнимает часть веса страницы и замедляет её загрузку.

В наших тестах 2026 года такие длинные цепочки приводили к потере до 18% передаваемого веса. Кроме того, растёт время загрузки страницы, что сразу бьёт по поведенческим показателям.

Правило простое: в цепочке должно быть не больше одного-двух переадресаций. Всё остальное – прямой путь к падению позиций.

В 2026 году грамотная совместная работа разработчиков и специалистов по оптимизации для поисковых систем – это уже не рекомендация, а обязательное условие для стабильных позиций. Специалисты в Кручу Верчу выстраивают чёткое взаимодействие между этими командами, чтобы подобные ошибки устранялись ещё на этапе написания кода.

Благодарим эксперта по поисковому продвижению Дениса Нарижного за подробные комментарии и реальные примеры из практики. Его опыт помогает всей команде агентства Кручу Верчу быстро решать технические проблемы в продвижении сайтов.