Google на своей конференции разработчиков I/O 2024 объявила, что ее новейшая модель генеративного искусственного интеллекта Gemini 1.5 Pro теперь доступна для подписчиков Gemini Advanced. Кроме того, Google также добавила несколько новых возможностей в модель Gemini 1.5 Pro, которая теперь доступна на более чем 35 языках в более чем 150 странах.

Gemini 1.5 Pro

Сундар Пичаи открыл мероприятие, рассказав о самой важной теме для обсуждения как пользователей, так и разработчиков – искусственном интеллекте. Генеральный директор Google Inc утверждает, что более 2 миллиардов пользователей используют Gemini, а более 1,5 миллиона разработчиков используют API-интерфейсы Gemini.

На мероприятии Пичаи объявил о расширении и более глубокой интеграции искусственного интеллекта в свои приложения и продукты. Генеральный директор Google Сундар Пичаи объявил, что Gemini 1.5 Pro будет иметь контекстное окно на 2 миллиона токенов (объем информации, который может понять модель ИИ). Благодаря этому модель генеративного ИИ может обрабатывать до часа видеоконтента, кодовые базы с более чем 30 000 строк кода и 1500-страничные документы.

Google также позволяет загружать файлы непосредственно с устройства или через Google Диск в Gemini, чтобы быстро получать факты, информацию и ответы. Здесь Gemini будет действовать как аналитик данных и даже сможет создавать собственные чаты и модели визуализации на основе загруженных данных. Все файлы и разговоры, происходящие на Gemini, останутся конфиденциальными и не будут использоваться для обучения модели.

Где будет использоваться Gemini 1.5 Pro:

- Google Фото: нейросеть поможет пользователям находить текст на фотографиях и создавать тематические коллажи. Более подробную информацию о новой функции можно узнать здесь.

- Gmail: Gemini 1.5 Pro будет интегрирован в почтовый клиент. Благодаря этому пользователи смогут составлять краткие обзоры недавно полученных писем. Например, можно будет попросить: «собери последние задачи, присланные мне на почту».

- Поисковик Google: в дополнение к вкладкам «Все», «Картинки», «Видео» и другим, в поисковике появится раздел AI. Здесь пользователь сможет увидеть краткую информацию по своему запросу. Например, можно будет спросить: «сколько стоят эти кроссовки» и приложить фото. Поисковик предоставит подробности о модели, укажет цены в различных магазинах и часы их работы.

- Google Meet: нейросеть будет способна создавать краткие обзоры всех ваших видеозвонков.

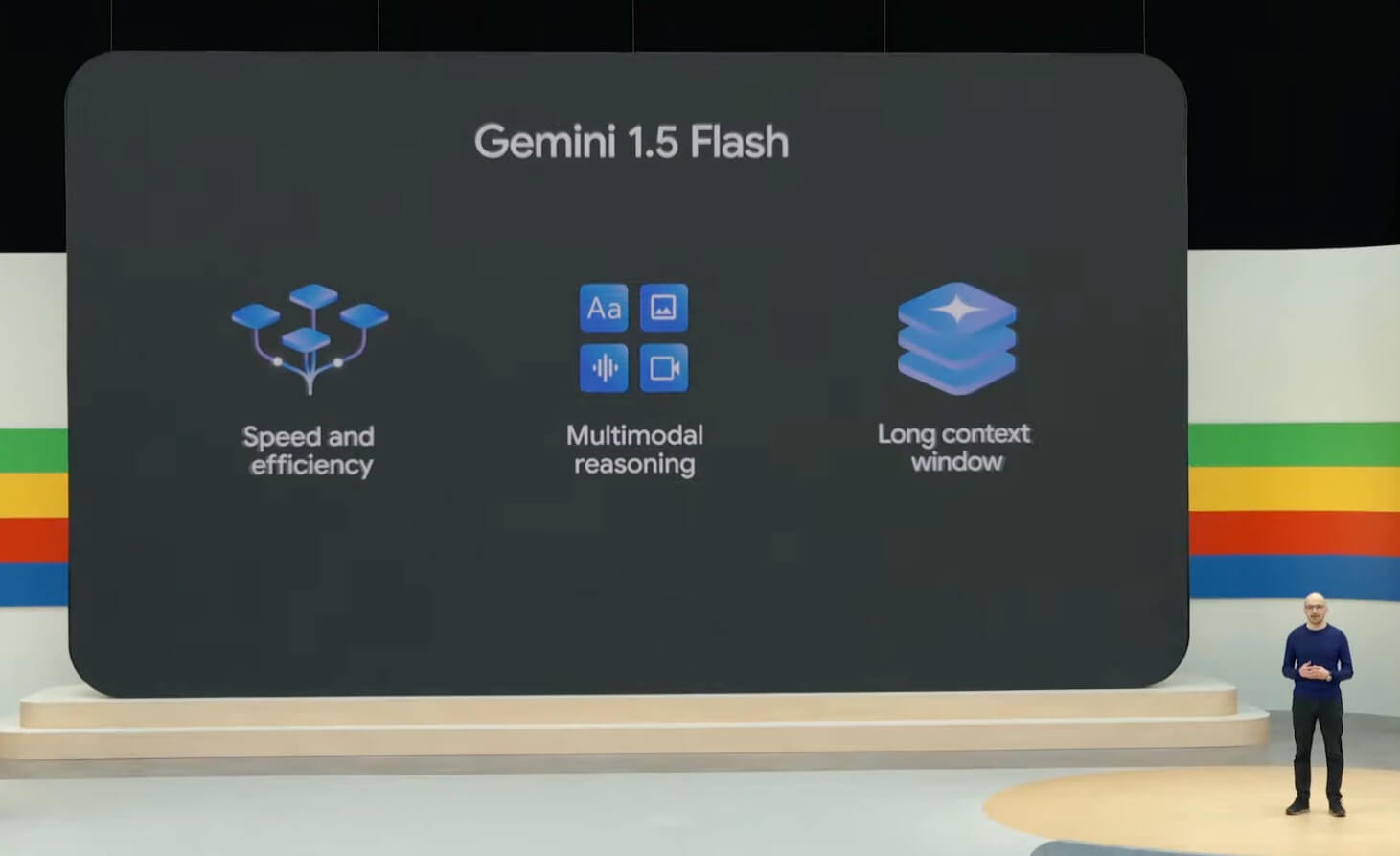

Gemini 1.5 Flash

Также Google представила Gemini 1.5 Flash – компактную мультимодальную модель, предназначенную для высокочастотных задач с низкой задержкой. Модель оснащена контекстным окном на 2 миллиона токенов и уже доступна в предварительной версии через Gemini API в Google AI Studio.

Основные различия между моделями заключаются в их назначении: Gemini 1.5 Flash оптимизирована для скорости, а Gemini 1.5 Pro – для выполнения более сложных и многоэтапных задач.

Джош Вудворд, вице-президент Google Labs, пояснил, что разработчики должны выбирать Gemini 1.5 Flash для задач, требующих быстрой обработки, а Gemini 1.5 Pro – для более сложных задач с многократным анализом.

Запуск Gemini 1.5 Flash произошел всего через день после анонса мультимодальной модели GPT-4o от OpenAI.

Gemini Live

Gemini Live, функция подписчика Gemini Advanced, вероятно, является самой интересной частью Gemini 1.5 Pro и той частью, которая, похоже, будет использовать GPT-4o. Судя по демонстрации, это больше похоже на разговор с другим человеком, чем на ИИ-помощника.

Gems

Gems – еще одна интересная функция, появившаяся в сервисе AI. По сути, это индивидуальные версии Gemini, адаптированные к потребностям пользователя. Google предлагает потенциальным пользователям предоставить Gem роль приятеля в тренажерном зале, су-шефа, партнера по программированию или руководства по творческому письму, чтобы получить конкретную помощь, когда она им понадобится.

Сроки выхода

Gemini 1.5 Pro будет интегрирована в продукты Google в течение текущего года. Первыми новые ИИ-функции получат пользователи из Соединённых Штатов.